« Projet 2017/2018 P11 » : différence entre les versions

| (10 versions intermédiaires par le même utilisateur non affichées) | |||

| Ligne 71 : | Ligne 71 : | ||

=== Construction d'une bête à corne === |

=== Construction d'une bête à corne === |

||

| + | <gallery widths=300px heights=300px> |

||

| − | + | Fichier:B_te_cornes_1.jpg |

|

| − | |||

| − | + | Fichier:B_te_cornes_2.jpg |

|

| ⚫ | |||

| − | |||

| + | </gallery> |

||

| ⚫ | |||

<br style="clear: both;" /> |

<br style="clear: both;" /> |

||

| Ligne 136 : | Ligne 136 : | ||

Le principal souci de ce projet est de développer les aspects technologiques de reconnaissance selon les contraintes suivantes : |

Le principal souci de ce projet est de développer les aspects technologiques de reconnaissance selon les contraintes suivantes : |

||

| − | + | * il faut un logiciel rapide et fluide, |

|

| − | + | * la base de données doit être stockée en ligne et nécessitera sûrement des mises à jour périodiques. |

|

Le moindre lag ou manque de réactivité peut affecter les performances de traduction et de ce fait la bonne qualité de la communication. |

Le moindre lag ou manque de réactivité peut affecter les performances de traduction et de ce fait la bonne qualité de la communication. |

||

| Ligne 167 : | Ligne 167 : | ||

|rowspan="3"| |

|rowspan="3"| |

||

* '''Handicapés''' |

* '''Handicapés''' |

||

| − | + | ** communiquer facilement avec des personnes entendantes |

|

| ⚫ | |||

| − | |||

| ⚫ | |||

| ⚫ | |||

| ⚫ | |||

| − | |||

| ⚫ | |||

| − | |||

| ⚫ | |||

| − | |||

* '''Non handicapés''' |

* '''Non handicapés''' |

||

| − | + | ** comprendre sans apprendre le langage des signes |

|

| Possibilité au client d’envoyer des feedbacks via l’application |

| Possibilité au client d’envoyer des feedbacks via l’application |

||

| Ligne 219 : | Ligne 215 : | ||

=== Vidéo d'introduction === |

=== Vidéo d'introduction === |

||

| − | [[Media:projet.mp4]] |

+ | [[Media:projet.mp4|Projet HOSMOSE]] |

| − | (vidéo trop lourde) |

+ | (vidéo trop lourde, rex : vous êtes surs que c'est ça le souci ?) |

=== Supports de présentation === |

=== Supports de présentation === |

||

| − | [[Media:PPT Projet.odp]] |

+ | [[Media:PPT Projet.odp|Présentation HOSMOSE]] |

=== Identité visuelle === |

=== Identité visuelle === |

||

Dernière version du 15 septembre 2017 à 11:57

Généralités

- Titre du projet : HosmoSigns : communiquer sans barrières

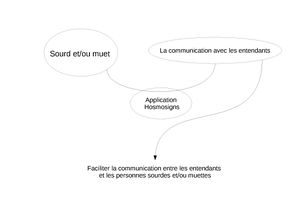

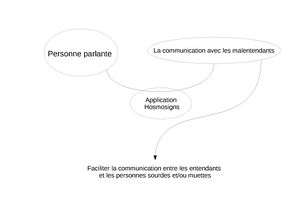

- Description : Application permettant de favoriser la communication entre sourds/muets et entendants.

- Nom de l'équipe : Hosmose

- Membres de l'équipe et photographie : Bernard Moragny Gaëlle ; Cocagne Pauline ; De Vargas Agathe ; Chevalier Lisa ; Bellini Carla ; Bardin Hugo ; Bracq Florent.

Présentation du concept

Objectifs

- Créer une application fluide et réactive qui permette de faciliter la communication entre sourds/muets et entendants

- Permettre aux entendants de comprendre la langue des signes en temps réel et même de l'apprendre

- Casser les barrières créées par le handicap

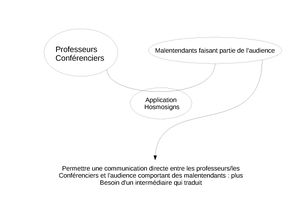

- Permettre une meilleure insertion sociale pour les sourds/muets : scolarité normale, intégration au marché du travail

- Sensibiliser les entendants aux difficultés liées au handicap

Positionnement par rapport à l'existant

A l'heure actuelle, il existe deux principaux projets concurrents : Google Gesture et Enable Talk.

Ces deux projets sont encore à l'état d'expérimentation, donc pas présents sur le marché. Ils ne permettent également qu'une traduction du langage des signes vers le langage oral.

Hosmosigns se démarque de ces deux projets par sa facilité d'utilisation : aucun accessoire externe n'est nécessaire, les signes et la parole sont tous deux directement reconnus et traduits.

Actions à développer

- Créer notre application support.

- Créer un système de QR code (le sourd/muet possédera une carte avec le QR code qui permettra à son interlocuteur de le scanner afin d'avoir l'application sur son téléphone).

- Développer un algorithme qui permettrait de reconnaître les mouvements de signes que fait le malentendant et qui le convertirait en langage informatique pour ensuite être transmis sous forme de langage oral.

- Dans un premier temps, l'application convertira en texte les paroles de l'entendant destinées au sourd/muet. Par la suite nous aimerions développer l'application afin qu'elle traduise le langage oral en langue des signes par le biais d'un personnage animé sur l'écran du téléphone. En effet, un grand nombre de sourds/muets ne savent pas lire en raison de leur handicap, ainsi cette amélioration permettrait d'aider tout les sourds/muets.

- Faire une campagne de communication à travers les réseaux sociaux, des forums, préventions dans les écoles, des concours et des partenariats avec des associations.

Moyens nécessaires

- Moyens humains Pour mener à bien ce projet nous aurons besoin d'employés :

- un directeur administratif et financier

- un directeur commercial, communication et partenariat

- deux développeurs techniques pour créer la base de données de traduction de notre application

- un développeur web pour créer l'application

- Sondage : étude de marché (pour s'assurer que l'application soit bien reçue par le public)

- Moyens financiers Tout projet nécessitant des fonds d'investissement, nous avons pensé à plusieurs moyens d'en obtenir :

- Prêt de la banque

- Aides de L’État provenant des Ministères de la Communication, de la Santé, de la Culture, de l’Éducation ou encore du Travail

- Sponsors.

- Publicités sur l'application.

Analyse du projet

Construction d'une bête à corne

Analyse du premier concurrent

- Google Gesture

Google Gesture est une application créée par deux étudiants de Stockholm. Cette application a pour but de traduire en temps réel le langage des signes en langage oral. L'application utilise l'électromyographie, technique médicale permettant de capter l'activité électrique des muscles lors de leur contraction. L'utilisateur (le sourd/muet) pose donc des électromyographes sur ces avants bras qui enregistrent ses gestes. L'enregistrement est ensuite envoyé sur l'application qui traduit les données en mots sonores.

Cette application est purement virtuelle. En effet, elle a été présentée lors du concours "Futures Lions" à Cannes en 2014 et a remporté le premier prix. Le projet est resté à l'état de concept et n'a toujours pas aboutis.

Pour notre projet nous avons choisis un autre système, une application qui permet de n'utiliser qu'un téléphone sans accessoires externes (capteurs). Ce principe repose sur la reconnaissance gestuelle ce qui permettrait une analyse plus complète du corps (buste et expressions du visage).

[

https://interpretelsf.wordpress.com/2014/06/22/google-gesture/

https://www.tuxboard.com/google-gesture/]

Analyse du second concurrent

- Enable Talk

Enable Talk est un projet présenté par 4 étudiants lors du Microsoft Imagine Cup en 2012 où ils ont remporté le premier prix. Le but est de faciliter la communication entre les sourds/muets et les entendants. Pour ce faire, ils ont imaginé un prototype de gants sensoriels relié grâce à un boîtier électronique communiquant avec un téléphone.

Les gants sont équipés de 15 détecteurs, des microcontrôleurs dernière génération, un accéléromètre, un gyroscope et une boussole afin qu’ils reconnaissent les mouvements et les décryptent. Ensuite les données sont transmises par Bluetooth au smartphone, sous Windows Phone 7 et Windows 8, qui traduit les informations en mots sonores. Le système se recharge à l'aide de mini panneaux solaires.

Ce projet n'a toujours pas été commercialisé. En effet, il existe un prototype mais il demande encore de nombreuses améliorations notamment la compatibilité avec d'autres systèmes d’exploitation et une plus grande capacité de reconnaissance gestuelle. De plus une étude de marché a été réalisée : le produit de départ devrait coûter 115 euros et ensuite le prix devrait descendre à 55 euros une fois la production lancée.

Si sa technologie est adoptée et approuvée, « Enable Talk » pourrait ouvrir aux marques les portes d’une nouvelle innovation : le hand-to-speech.

Scénario d'usage du produit ou du concept envisagé

Quel intérêt à utiliser HosmoSigns ? Imaginez :

Alice, une étudiante sourde/muette de 21 ans, arrive dans une boutique de vêtements et répère un article mais ne trouve pas sa taille. Martine, la gérante, voyant sa cliente dans le besoin, s'approche et propose de l'aider. Alice lui indique par un signe qu'elle ne peut pas parler et elle sort sa carte HosmoSigns : sur celle-ci est indiquée son identité et la phrase suivante "Je ne peux pas parler mais vous pouvez scanner ce QR Code pour parler avec moi".

Martine sort son téléphone et scanne ce code, ce qui la renvoie vers l'application HosmoSigns sur une plateforme de téléchargement d'applications. Après un téléchargement et une mise en route rapide, l'application est prête à être utilisée. L'application affiche le message suivant sur le téléphone de Martine : « Bonjour, bienvenue sur HosmoSigns, vous pouvez désormais communiquer plus facilement avec la personne en face de vous. Veuillez mettre votre téléphone au niveau de votre poitrine comme sur le schéma indiqué.»

Alice donne à Martine le support qu’elle a reçu en même temps que sa carte en s’inscrivant sur HosmoSigns.com. Martine place son téléphone sur le support comme indiqué et dès lors elle peut communiquer facilement avec Alice. Le langage des signes qu’utilise Alice est instantanément traduit en langage oral pour Martine grâce au haut parleur du téléphone.

A l’inverse, lorsque Martine parle le téléphone retranscrit à l’écrit ses paroles pour Alice.

Alice est donc repartie avec sa robe bleue taille 38.

Réponse à la question difficile

Comment l'application peut-elle traduire instantanément le langage des signes en langage oral?

Le principal souci de ce projet est de développer les aspects technologiques de reconnaissance selon les contraintes suivantes :

- il faut un logiciel rapide et fluide,

- la base de données doit être stockée en ligne et nécessitera sûrement des mises à jour périodiques.

Le moindre lag ou manque de réactivité peut affecter les performances de traduction et de ce fait la bonne qualité de la communication.

Ce projet présente donc des contraintes informatique et technologique assez importantes mais pas insurmontables.

Le Business Model Canvas

| Partenaires clefs | Activités clefs | Proposition de valeur | Relation avec les clients | Segments de clientèle |

|---|---|---|---|---|

|

Etat, Ministères (santé, communication, éducation, travail) Associations sourds/muets |

Créer la base de données de la langue des signes

Développer l'algorithme de reconnaissance de la langue des signes à partir de la base de données, l'application Hosmosigns, le site hosmosigns.com Manager des équipes de développement Mettre en place la campagne de communication (sponsors, événements, etc) |

|

Possibilité au client d’envoyer des feedbacks via l’application

FAQ sur le site web de l'application |

Personnes ayant besoin de communication mais n'ayant pas la possibilité de le faire à cause de la barrière créée par le handicap |

| Ressources clefs | Canaux de distribution | |||

| Ordinateurs et logiciels de développement

Ingénieurs, développeurs, designers, managers Partenaires |

Evénements, publicité, plateforme de téléchargements d'applications | |||

| Structure des coûts | Prix de vente | Analyse de la concurrence | ||

| Électricité, locaux équipés (ordinateurs...)

Communication, marketing Salaires des employés Application (8700e minimum d’après notre estimation https://www.combiencoutemonapp.com/) Matériel nécessaire aux utilisateurs : carte de membre avec le QR Code, collier support

|

Gratuit | Projets peu aboutis à l'heure actuelle | ||

Supports de communication

Vidéo d'introduction

(vidéo trop lourde, rex : vous êtes surs que c'est ça le souci ?)

Supports de présentation

Identité visuelle